- 1 Présentation de NotebookLM

- 2 Le problème : trop d’information, pas assez de compréhension

- 3 NotebookLM : un outil de synthèse guidée par sources

- 4 Le workflow canon : Sources → Chat → Studio → Notes → Partage

- 5 Constituer un corpus utile : diversité des sources et étiquetage

- 6 Travailler dans le chat : résumer, analyser, comparer, détecter les limites

- 7 Sauvegarde et confidentialité : pourquoi “Save to note” change tout

- 8 Studio : comprendre plus profondément en changeant de représentation

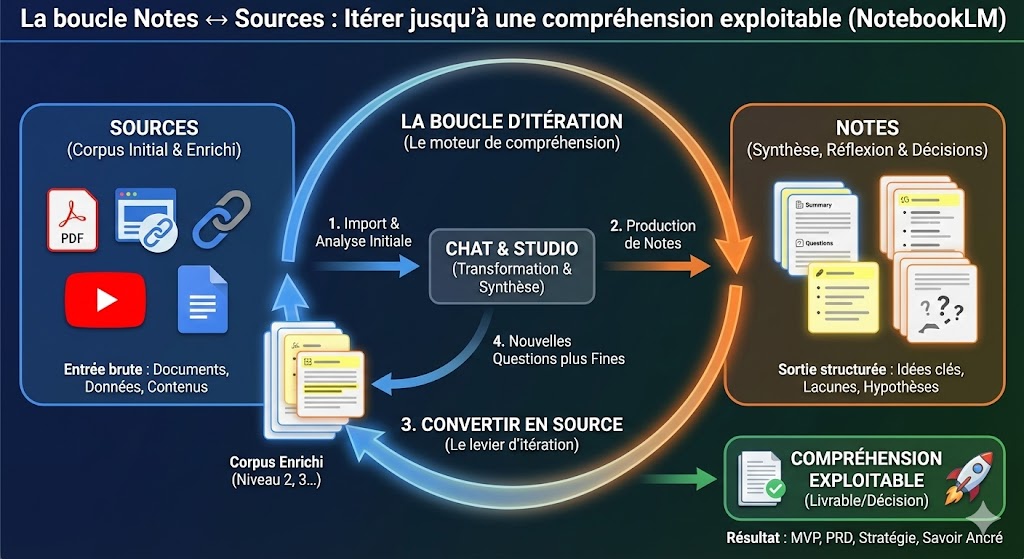

- 9 La boucle Notes ↔ Sources : itérer jusqu’à une compréhension exploitable

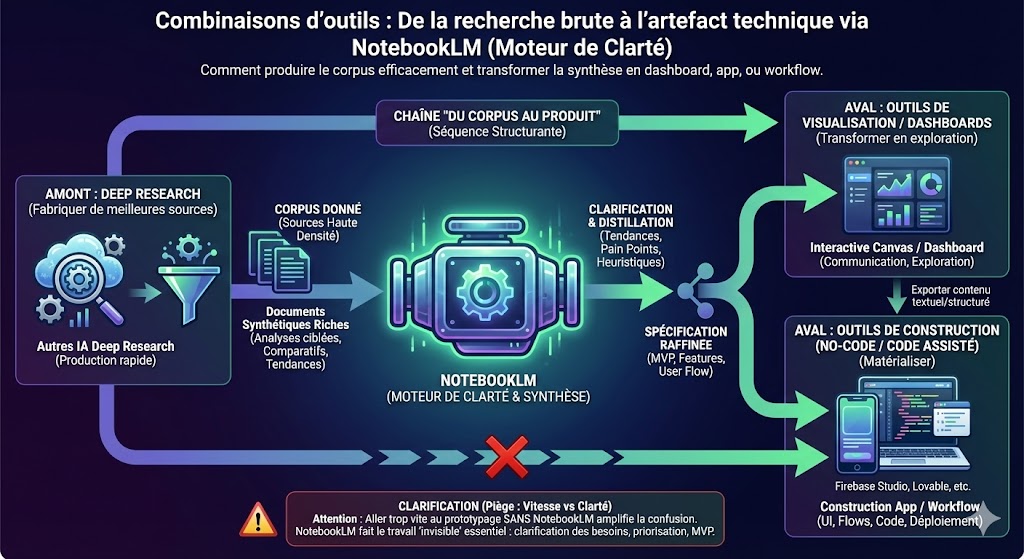

- 10 Combinaisons d’outils : Deep Research, dashboards, prototypage, automatisations

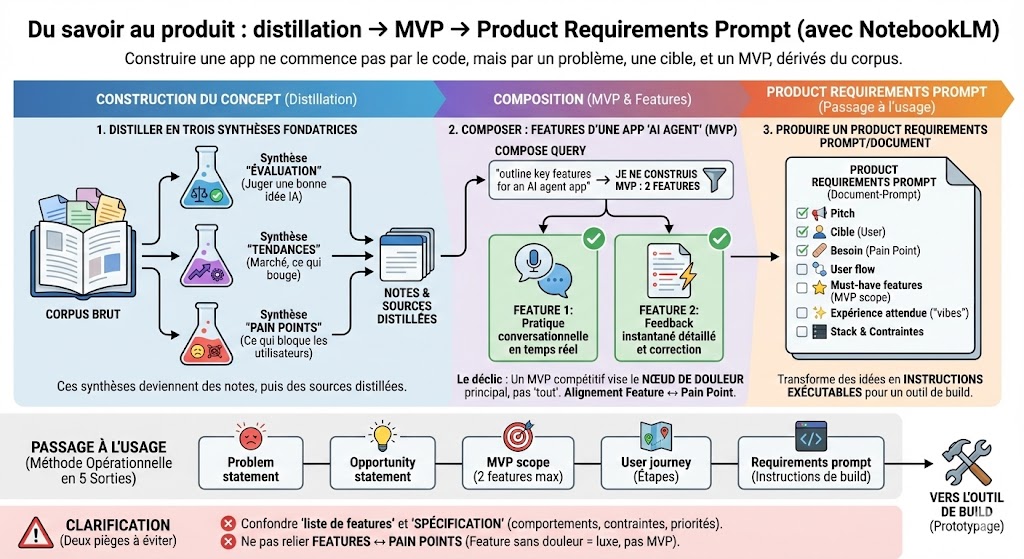

- 11 Du savoir au produit : distillation → MVP → Product Requirements Prompt

- 12 Gratuit, Pro, Entreprise : ce qui change réellement

- 13 Synthèses

- 14 Auteur : WebToulouse

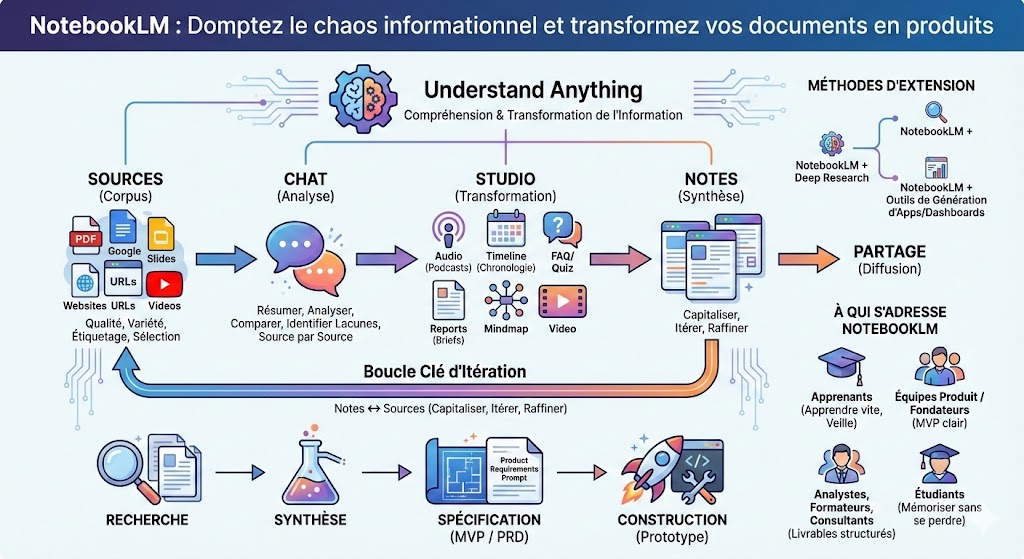

Présentation de NotebookLM

Cet article expose NotebookLM comme un outil de compréhension et de transformation de l’information, puis comme une brique dans une chaîne de production plus large (recherche → synthèse → spécification → construction d’un prototype).

- La promesse centrale : “understand anything” comme réponse au problème moderne (trop d’information, pas assez de sens).

- Le workflow principal : sources → chat → Studio → notes → partage.

- Les types de sources et la logique de “corpus” (qualité, variété, étiquetage, sélection).

- L’usage rigoureux du chat : résumer, analyser, comparer, identifier les lacunes, et surtout travailler “source par source”.

- Les fonctions Studio : audio/video/mindmap/reports/quiz/FAQ/timeline, et la logique pédagogique derrière chacune.

- La boucle clé : Notes ↔ Sources (capitaliser, itérer, raffiner).

- Les méthodes d’extension : NotebookLM + Deep Research, NotebookLM + outils de génération d’apps/dashboards.

- Le passage “du contenu au produit” : distiller en MVP, puis produire un Product Requirements Prompt/Document utilisable par des outils de code assisté.

- Les limites et la différence entre gratuit / pro / entreprise (selon le corpus fourni).

Ce que vous saurez faire et comprendre après lecture

Après lecture, vous saurez :

- Expliquer précisément ce que NotebookLM fait bien : synthétiser et rendre intelligible un corpus hétérogène.

- Construire un notebook “propre” : sources étiquetées, sélection contrôlée, sorties sauvegardées.

- Utiliser NotebookLM pour extraire tendances, pain points, concurrents, et expliciter ce qui manque dans les sources.

- Choisir le bon outil Studio selon l’objectif : comprendre, mémoriser, communiquer, décider.

- Mettre en place une boucle d’itération : questions → notes → conversion en sources → questions plus fines.

- Transformer un corpus en spécification de produit : features, user flow, contraintes, “vibes”, MVP.

- Chaîner NotebookLM avec d’autres outils (Deep Research, générateurs de dashboards, outils de prototypage) sans perdre la logique documentaire.

À qui s’adresse NotebookLM

- Aux personnes qui veulent apprendre vite à partir de documents (veille, rapports, vidéos, UGC).

- Aux équipes produit et fondateurs qui veulent transformer une recherche en MVP clair.

- Aux analystes, formateurs, consultants : production de livrables structurés (briefs, timelines, FAQ, executive summary).

- Aux étudiants : apprendre/mémoriser à partir d’un corpus sans s’y perdre.

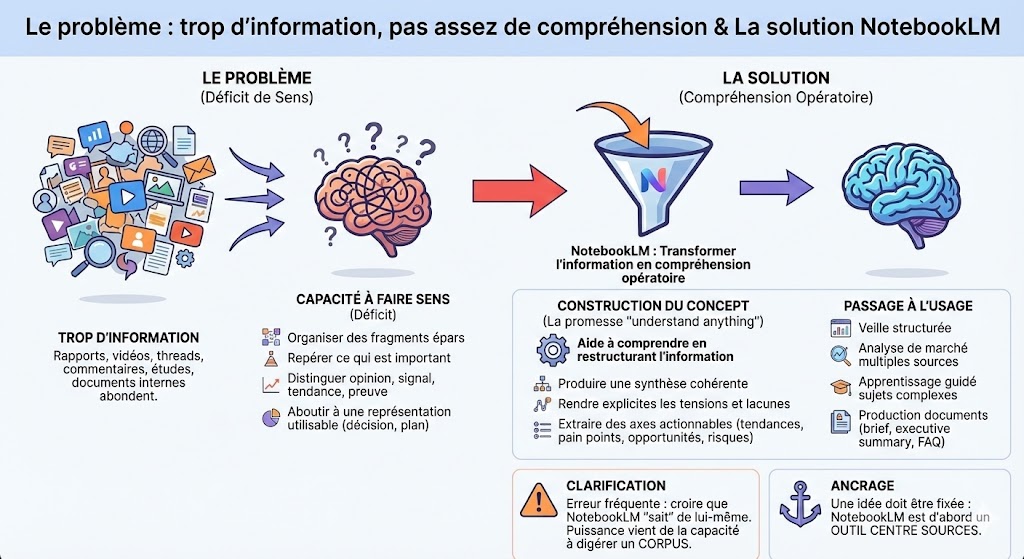

Le problème : trop d’information, pas assez de compréhension

Dans l’économie actuelle, le déficit n’est pas la connaissance disponible : rapports, vidéos, threads, commentaires, études, documents internes abondent. Le déficit est la capacité à faire sens, c’est-à-dire :

- organiser des fragments épars,

- repérer ce qui est important,

- distinguer opinion, signal, tendance et preuve,

- aboutir à une représentation utilisable (décision, plan, synthèse, spécification).

NotebookLM existe pour ce besoin précis : transformer une masse d’information en compréhension opératoire.

Construction du concept

La promesse “understand anything” doit être lue comme :

NotebookLM vous aide à comprendre en restructurant l’information plutôt qu’en la “récitant”.

Comprendre, ici, signifie :

- produire une synthèse cohérente,

- rendre explicites les tensions et les lacunes,

- extraire des axes actionnables (tendances, pain points, opportunités, risques).

Passage à l’usage

Cette orientation explique pourquoi NotebookLM est particulièrement adapté aux tâches suivantes :

- veille structurée,

- analyse de marché à partir de sources multiples,

- apprentissage guidé de sujets complexes,

- production de documents (brief, executive summary, FAQ).

Clarification

Erreur fréquente : croire que NotebookLM “sait” de lui-même.

Sa puissance vient de sa capacité à digérer un corpus. Sans corpus, il n’a pas de terrain solide.

Pour comprendre le reste, une idée doit être fixée : NotebookLM est d’abord un outil centré sources. Le chapitre suivant explicite ce point.

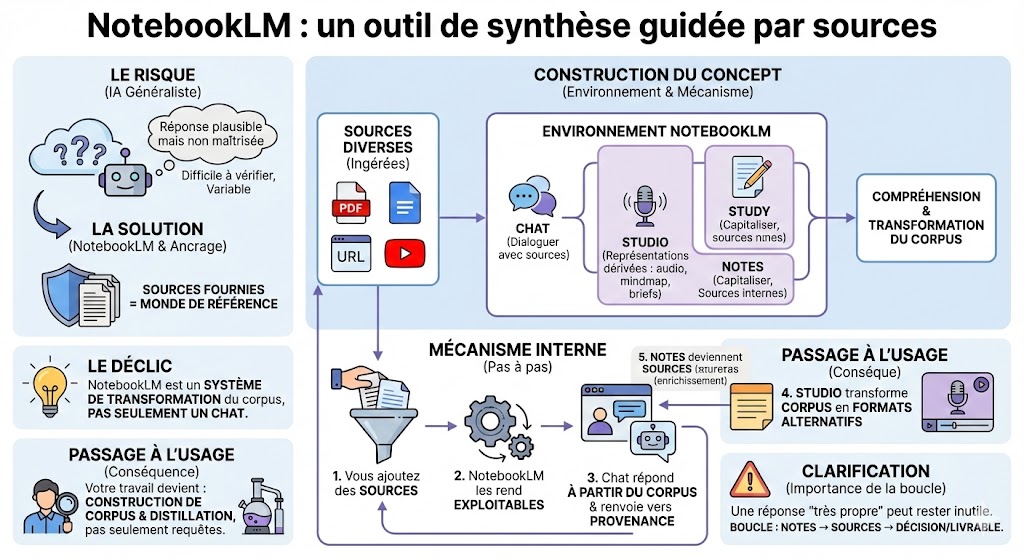

NotebookLM : un outil de synthèse guidée par sources

Le risque principal des assistants IA généralistes est la réponse plausible mais non maîtrisée : difficile à vérifier, variable selon l’humeur du modèle et la formulation du prompt.

NotebookLM réduit ce risque en se fondant sur un principe : les sources fournies sont le monde de référence.

Construction du concept

Définition

NotebookLM est un environnement qui :

- ingère des sources diverses,

- permet de dialoguer avec elles,

- produit des représentations dérivées (audio, mindmap, briefs),

- et vous laisse capitaliser sous forme de notes et de sources internes.

Mécanisme interne (pas à pas)

- Vous ajoutez des sources.

- NotebookLM les rend exploitables.

- Le chat répond “à partir” de ce corpus et renvoie vers la provenance.

- Studio transforme ce même corpus en formats alternatifs.

- Vos notes peuvent devenir des sources, enrichissant le corpus.

Le déclic :

NotebookLM est un système de transformation du corpus, pas seulement un chat.

Passage à l’usage

Une conséquence immédiate : votre travail devient un travail de construction de corpus et de distillation, pas seulement de requêtes.

Clarification

Une réponse “très propre” peut rester inutile si elle n’aboutit à rien. D’où l’importance de la boucle qui viendra plus tard : notes → sources → décision/livrable.

On peut maintenant décrire le workflow de base, car tout le manuel en est une variation.

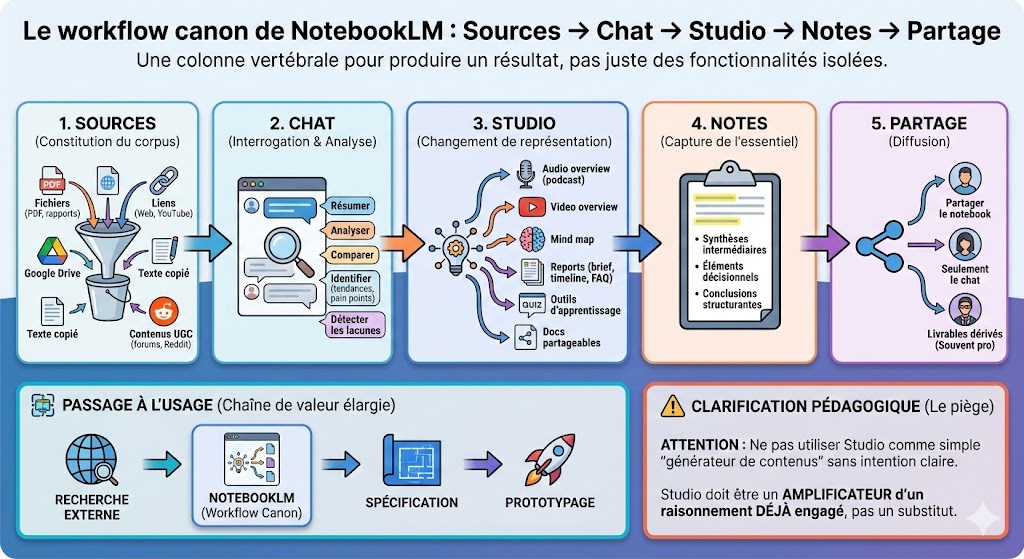

Le workflow canon : Sources → Chat → Studio → Notes → Partage

Un manuel utile ne décrit pas des fonctionnalités isolées, mais un enchaînement qui produit un résultat. NotebookLM a un workflow naturel qui sert de colonne vertébrale.

Construction du concept

Étape 1 : Sources

Vous constituez un corpus à partir de :

- fichiers (rapports, PDF),

- liens web et YouTube,

- éléments Google Drive,

- texte copié (par exemple extrait d’un autre outil),

- contenus UGC (forums, Reddit, etc.) via découverte/import.

Étape 2 : Chat

Vous interrogez le corpus pour :

- résumer,

- analyser,

- comparer,

- identifier tendances, pain points, acteurs,

- détecter ce que les sources ne couvrent pas.

Étape 3 : Studio

Vous changez de représentation :

- audio overview (podcast),

- video overview,

- mind map,

- reports (brief, study guide, timeline, FAQ, etc.),

- outils d’apprentissage (quiz),

- documents partageables.

Étape 4 : Notes

Vous capturez ce qui ne doit pas se perdre :

- synthèses intermédiaires,

- éléments décisionnels,

- conclusions structurantes.

Étape 5 : Partage (souvent pro)

Vous partagez le notebook, ou seulement le chat, ou des livrables dérivés.

Passage à l’usage

Ce workflow est suffisamment puissant seul. Mais son intérêt maximal apparaît quand vous l’insérez dans une chaîne plus large (recherche externe → notebook → spécification → prototypage), ce qui sera traité plus loin.

Clarification

Le piège : utiliser Studio comme “générateur de contenus” avant d’avoir clarifié l’intention. Studio doit être un amplificateur d’un raisonnement déjà engagé, pas un substitut.

Le chapitre suivant montre comment construire un corpus exploitable, en insistant sur la variété des sources et la nécessité d’indiquer ce que chaque source représente.

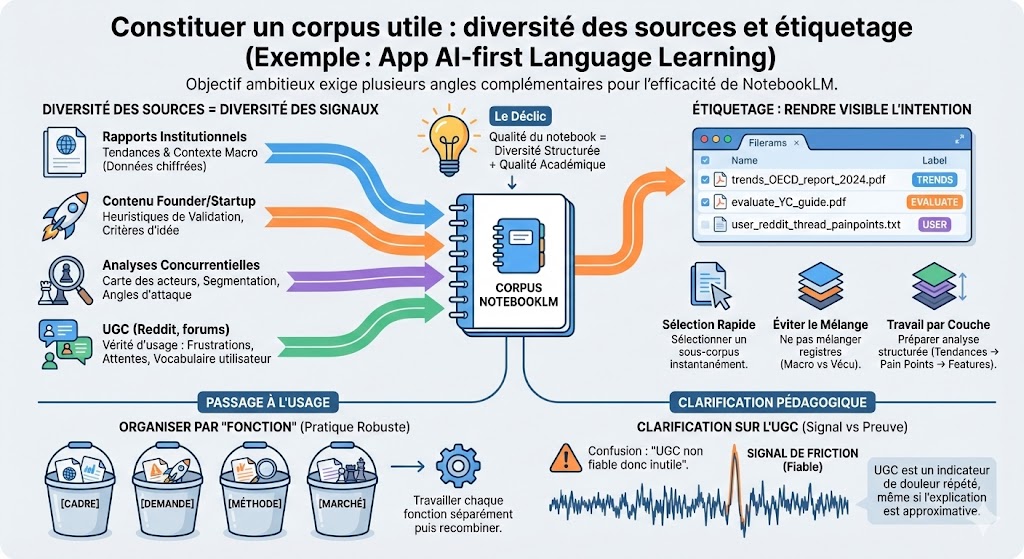

Constituer un corpus utile : diversité des sources et étiquetage

Dans l’exemple du transcript, l’objectif est ambitieux : concevoir une application “AI-first” de language learning. Cela exige plusieurs angles :

- tendances de marché,

- pain points utilisateurs,

- méthodes de validation startup,

- compétiteurs,

- références crédibles.

NotebookLM devient efficace quand les sources couvrent ces dimensions de façon complémentaire.

Construction du concept

Diversité des sources, diversité des signaux

- Rapports institutionnels : donnent les tendances et le contexte macro (ex. OECD).

- Contenu “founder”/startup (ex. YC) : donne heuristiques de validation, critères d’idée.

- Analyses concurrentielles : donnent carte des acteurs, segmentation, angles d’attaque.

- UGC (Reddit, forums) : donne la vérité d’usage : frustrations, attentes, vocabulaire utilisateur.

Le déclic :

La qualité d’un notebook vient autant de la diversité structurée que de la “qualité académique”.

Étiquetage : rendre visible l’intention de chaque source

Renommer les sources (“trends”, “evaluate”, “user…”) est plus qu’un rangement :

- cela vous permet de sélectionner rapidement un sous-corpus,

- cela évite de mélanger des registres (macro vs vécu utilisateur),

- cela prépare un travail “par couche” (tendances → pain points → features).

Passage à l’usage

Une pratique robuste consiste à organiser les sources par “fonction” :

- Sources “cadre” (trends).

- Sources “demande” (pain points).

- Sources “méthode” (comment évaluer).

- Sources “marché” (concurrents).

Puis à travailler chaque fonction séparément avant de recombiner.

Clarification pédagogique

Confusion fréquente : “UGC n’est pas fiable donc inutile.”

UGC est rarement fiable comme preuve, mais souvent extrêmement fiable comme signal de friction : ce que les gens répètent est un indicateur de douleur, même si les explications sont parfois approximatives.

Une fois le corpus construit, la maîtrise se joue dans le chat : savoir isoler, interroger et repérer les limites.

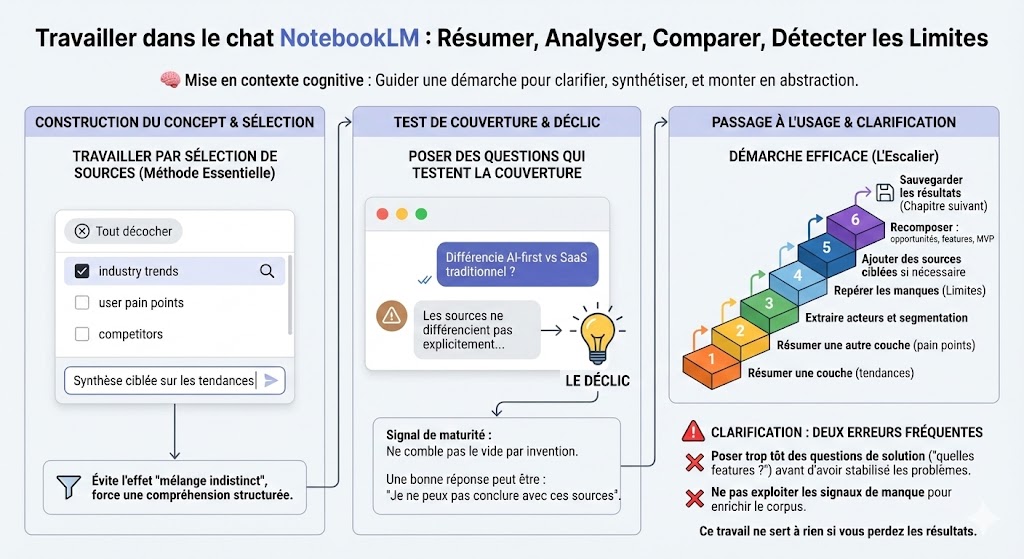

Travailler dans le chat : résumer, analyser, comparer, détecter les limites

Mise en contexte cognitive

La force du chat NotebookLM n’est pas seulement d’obtenir une réponse, mais de guider une démarche :

- clarifier une couche de réalité,

- produire une synthèse sauvegardable,

- puis monter d’un niveau d’abstraction.

Construction du concept

Travailler par sélection de sources

Le transcript insiste sur une pratique essentielle :

- décocher tout,

- ne garder qu’une catégorie (ex. “industry trends”),

- demander une synthèse ciblée,

- puis passer à une autre catégorie (ex. “user pain points”).

Cette méthode évite l’effet “mélange indistinct” et force une compréhension structurée.

Poser des questions qui testent la couverture du corpus

Un moment important : NotebookLM indique quand les sources ne suffisent pas (“les sources ne différencient pas explicitement AI-first vs SaaS traditionnel”).

Ce comportement est un signal de maturité du système : il ne comble pas le vide par invention (ou du moins, il signale l’absence).

Le déclic :

Une bonne réponse peut être : “je ne peux pas conclure avec ces sources”.

Passage à l’usage

Une démarche efficace suit un escalier :

- Résumer une couche (tendances).

- Résumer une autre couche (pain points).

- Extraire acteurs et segmentation.

- Repérer les manques.

- Ajouter des sources ciblées si nécessaire.

- Recomposer : opportunités, features, MVP.

Clarification

Deux erreurs fréquentes :

- Poser trop tôt des questions de solution (“quelles features ?”) avant d’avoir stabilisé les problèmes.

- Ne pas exploiter les signaux de manque (“sources insuffisantes”) pour enrichir le corpus.

Ce travail ne sert à rien si vous perdez les résultats. D’où le chapitre suivant sur la sauvegarde et la logique de confidentialité.

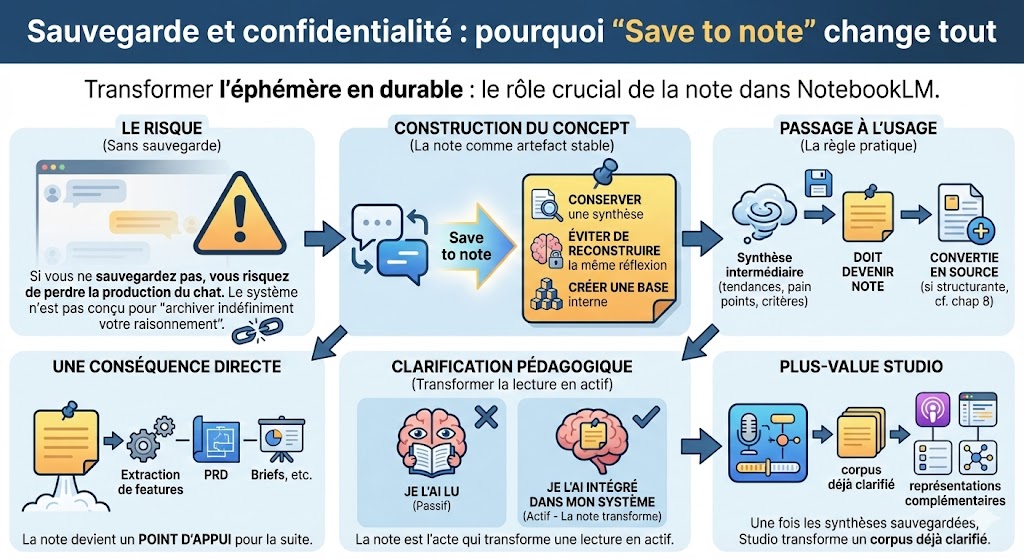

Sauvegarde et confidentialité : pourquoi “Save to note” change tout

Dans le transcript, une affirmation revient : si vous ne sauvegardez pas, vous risquez de perdre la production du chat, car le système n’est pas conçu pour “archiver indéfiniment votre raisonnement” comme un carnet automatique.

Construction du concept

La note comme artefact stable

“Save to note” transforme un échange en objet stable. Cela permet :

- de conserver une synthèse,

- d’éviter de reconstruire la même réflexion,

- de créer une base interne.

Une conséquence directe

La note n’est pas seulement une mémoire. Elle devient un point d’appui pour la suite : extraction de features, PRD, briefs, etc.

Passage à l’usage

La règle pratique :

- toute synthèse intermédiaire (tendances, pain points, critères d’évaluation) doit devenir note,

- puis, si elle devient structurante, être convertie en source (chapitre 8).

Clarification pédagogique

Beaucoup d’utilisateurs confondent “je l’ai lu” et “je l’ai intégré dans mon système”. La note est l’acte qui transforme une lecture en actif.

Une fois les synthèses sauvegardées, Studio devient plus utile : il transforme un corpus déjà clarifié en représentations complémentaires.

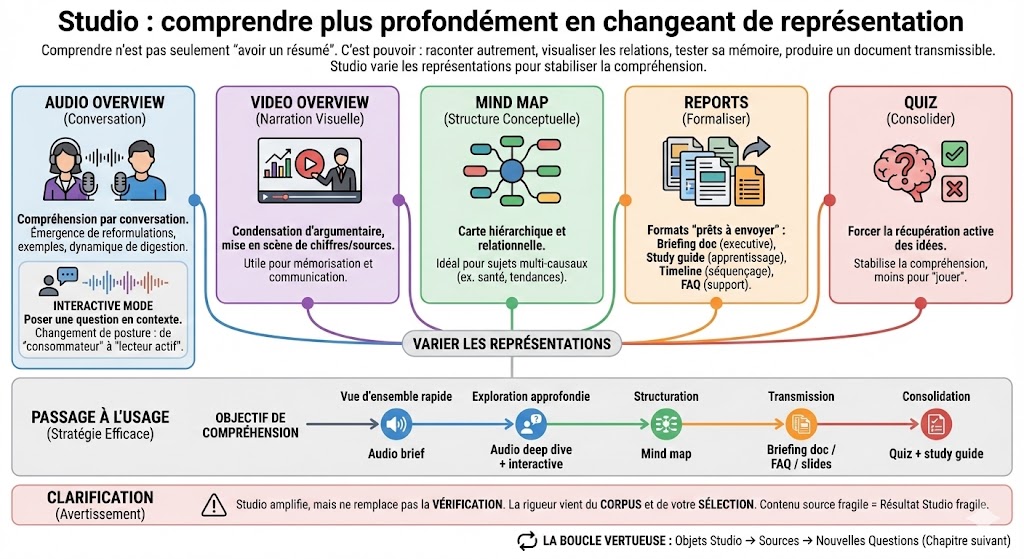

Studio : comprendre plus profondément en changeant de représentation

Comprendre n’est pas seulement “avoir un résumé”. Comprendre, c’est pouvoir :

- raconter autrement,

- visualiser les relations,

- tester sa mémoire,

- produire un document transmissible.

Studio sert exactement à cela : varier les représentations pour stabiliser la compréhension.

Construction du concept

Audio overview : la compréhension par conversation

Le podcast à deux hôtes fait émerger :

- des reformulations,

- des exemples,

- une dynamique qui facilite la digestion.

La fonction “interactive mode” ajoute un second niveau : vous pouvez poser une question en contexte, comme si vous interrompiez un exposé.

Point pédagogique crucial : ce n’est pas un gadget, c’est un changement de posture. Vous passez de “consommateur d’audio” à “lecteur actif”.

Video overview : la compréhension par narration visuelle

Le video overview condense souvent un argumentaire et met en scène des chiffres ou des éléments issus des sources, ce qui est utile pour la mémorisation et la communication.

Mind map : la structure conceptuelle

La mind map donne une carte hiérarchique et relationnelle. Elle est particulièrement utile quand le sujet est multi-causal (ex. santé mentale, tendances éducation, etc.).

Reports : formaliser

Les reports produisent des formats “prêts à envoyer” :

- briefing document (executive),

- study guide (apprentissage),

- timeline (séquençage historique ou causale),

- FAQ (marketing informatif ou support).

Quiz : consolider

Le quiz sert moins à “jouer” qu’à forcer la récupération active des idées, ce qui stabilise la compréhension.

Passage à l’usage

Une stratégie efficace est de choisir Studio selon le type de compréhension recherché :

- Vue d’ensemble rapide : audio brief.

- Exploration approfondie : audio deep dive + interactive questions.

- Structuration : mind map.

- Transmission : briefing doc / FAQ / slides.

- Consolidation : quiz + study guide.

Clarification

Studio peut produire des formats très convaincants même si le contenu source est fragile. Studio ne remplace pas la vérification : il amplifie. La rigueur vient toujours du corpus et de votre sélection.

Studio produit des objets. Mais la vraie puissance commence quand vous créez une boucle : objets → sources → nouvelles questions. C’est le chapitre suivant.

La boucle Notes ↔ Sources : itérer jusqu’à une compréhension exploitable

Un système devient puissant quand il s’améliore par itération. NotebookLM propose une boucle simple :

- vous extrayez une synthèse,

- vous la sauvegardez,

- vous la convertissez en source,

- puis vous posez des questions plus fines en vous appuyant sur cette synthèse.

Construction du concept

Pourquoi convertir en source ?

Convertir une note (ou un report) en source :

- stabilise une “version consolidée”,

- réduit le temps de recomposition,

- permet de travailler à un niveau plus élevé (méta-synthèse).

Dans l’exemple “performance review”, cette boucle sert à raffiner une décision : synthèses partielles → sources internes → question de promotion.

Le déclic :

Vous fabriquez des sources intermédiaires, plus proches de vos besoins que les documents bruts.

Passage à l’usage

Une méthode en trois couches fonctionne particulièrement bien :

- Sources brutes (rapports, vidéos, UGC).

- Sources distillées (résumés ciblés, briefs, timelines).

- Sources décisionnelles (MVP, critères, PRD, recommandations).

Chaque couche réduit le bruit et augmente l’actionnabilité.

Clarification pédagogique

Risque : empiler des sources distillées sans contrôle.

Une distillation mauvaise devient une “erreur durable”. On ne convertit en source que ce qui est :

- fidèle au corpus,

- utile de façon répétée,

- structurant.

Une fois cette boucle maîtrisée, NotebookLM devient une brique d’une chaîne plus grande : on peut l’alimenter par Deep Research, puis exporter vers des outils de prototypage. C’est le chapitre 9.

Combinaisons d’outils : Deep Research, dashboards, prototypage, automatisations

NotebookLM est très puissant sur un corpus donné. La question naturelle devient : comment produire ce corpus efficacement, puis comment transformer le résultat en artefact technique (dashboard, app, workflow) ?

Construction du concept

NotebookLM + Deep Research : fabriquer de meilleures sources

Deep Research (dans d’autres outils IA) sert à produire des documents synthétiques riches : analyses de marché ciblées, comparatifs, tendances régionales, etc.

La logique est cohérente :

- NotebookLM est aussi bon que ses sources.

- Deep Research est un moyen rapide de produire une source de haute densité.

- On ajoute cette source au notebook pour l’intégrer à la réflexion.

NotebookLM + outils de visualisation/dashboards

Quand NotebookLM produit une timeline, un rapport ou une structure, on peut :

- exporter le contenu,

- le passer dans un outil qui génère une visualisation interactive (canvas, dashboard).

La valeur : transformer une synthèse textuelle en outil de communication/exploration.

NotebookLM + outils de construction (no-code / code assisté)

Le transcript décrit une chaîne typique :

- NotebookLM distille tendances + pain points + heuristiques d’évaluation,

- NotebookLM propose features et MVP,

- un LLM généraliste sert à préciser pitch, user flow, “vibes”, parcours,

- puis un outil de prototypage (Firebase Studio, Lovable, etc.) construit l’app.

Le déclic :

NotebookLM est le moteur de clarté ; l’outil de prototypage est le moteur d’exécution.

Passage à l’usage

Une règle simple :

- utiliser NotebookLM pour réduire l’ambiguïté (ce qu’on construit, pourquoi, pour qui),

- utiliser l’outil de build pour matérialiser (UI, flows, code, déploiement).

Clarification

Piège : aller trop vite au prototypage.

La vitesse de construction amplifie la confusion si la spécification est floue. NotebookLM sert précisément à faire le travail “invisible” qui rend la construction efficace : clarification des besoins, priorisation, MVP.

Le chapitre suivant formalise la séquence “du corpus au produit”, car c’est la partie la plus structurante du transcript.

Du savoir au produit : distillation → MVP → Product Requirements Prompt

Construire une application ne commence pas par le code. Cela commence par :

- un problème réel,

- une population,

- une proposition de valeur,

- un parcours,

- et un MVP minimal.

NotebookLM sert à dériver ces éléments depuis le corpus.

Construction du concept

Distiller en trois synthèses fondatrices

Le transcript montre une démarche très reproductible :

- Synthèse “évaluation” : comment juger une bonne idée d’app IA.

- Synthèse “tendances” : ce que le marché fait / ce qui bouge.

- Synthèse “pain points” : ce qui bloque réellement les utilisateurs.

Ces synthèses deviennent des notes, puis des sources distillées.

Composer : features d’une app “AI agent”

En sélectionnant les sources distillées, on demande :

- “outline key features for an AI agent app”,

puis on force la contrainte centrale : - “je ne construis qu’un MVP : 2 features”.

Ce moment est crucial : une IA produit naturellement des listes longues. La compétence produit consiste à couper.

Choisir 2 features : la logique de l’agent

Dans l’exemple, la conclusion est :

- pratique conversationnelle en temps réel,

- feedback instantané détaillé et correction.

Ce sont des features alignées avec le pain point identifié : manque de fluence conversationnelle et de compréhension profonde.

Le déclic :

Un MVP compétitif ne vise pas “tout”, il vise le nœud de douleur principal.

Produire un Product Requirements Prompt/Document

Avant le prototypage, on passe par un document-prompt qui oblige à préciser :

- pitch,

- cible,

- besoin,

- user flow,

- must-have features,

- expérience attendue (“vibes”),

- stack et contraintes.

Cette étape n’est pas décorative : elle transforme un ensemble d’idées en instructions exécutables par un outil de build.

Passage à l’usage

Une méthode opérationnelle en cinq sorties :

- “Problem statement” : la douleur principale en une phrase.

- “Opportunity statement” : pourquoi maintenant, pourquoi l’IA.

- “MVP scope” : 2 features maximum + ce qui est explicitement exclu.

- “User journey” : étapes principales.

- “Requirements prompt” : instructions de build structurées.

Clarification

Deux pièges :

- Confondre “liste de features” et “spécification”. La spécification définit comportements, entrées/sorties, contraintes, et priorités.

- Ne pas relier features ↔ pain points. Une feature sans douleur associée est un luxe, donc rarement MVP.

On a maintenant un pipeline complet. Il reste à comprendre ce que change réellement le passage au Pro/Enterprise, pour calibrer les attentes.

Gratuit, Pro, Entreprise : ce qui change réellement

Le transcript insiste : la version gratuite est déjà extrêmement riche. L’enjeu est de savoir ce que l’on gagne réellement avec les niveaux supérieurs.

Construction du concept

Trois différences évoquées :

- Capacité : plus de sources (ex. 50 → 300).

- Personnalisation : davantage d’options de configuration (style, longueur) et de réglage des outputs.

- Collaboration : partage, permissions, welcome note, analytics (activité) ; sécurité renforcée en entreprise.

Passage à l’usage

Lecture pragmatique :

- Si vous travaillez seul sur des corpus modestes : le gratuit suffit souvent.

- Si vous travaillez en équipe, ou sur des corpus très larges : l’augmentation de capacité et les fonctions de partage deviennent structurantes.

- Si vous êtes en contexte sensible (entreprise) : les garanties et la gouvernance importent plus que les fonctionnalités.

Clarification pédagogique

Le Pro n’améliore pas automatiquement la qualité. Il améliore la capacité et le confort. La qualité reste un produit de la curation et de la distillation.

Il est temps de recomposer le modèle mental final : comment raisonner durablement sur NotebookLM dans un workflow moderne.

Synthèses

Les trois couches de valeur de NotebookLM

- Compréhension : résumer, analyser, comparer, expliciter les manques.

- Représentation : audio, vidéo, mind map, briefs, timelines, FAQ.

- Capitalisation : notes converties en sources → amélioration par itération.

Le pipeline “apprentissage → production”

- Sources variées (macro + méthode + UGC).

- Travail par sous-corpus (tendances puis pain points).

- Synthèses sauvegardées et converties.

- Extraction MVP : couper à 2 features.

- PRD/Prompt : rendre exécutable.

- Prototypage : matérialiser dans un outil de build.

Synthèse finale du manuel

Modèle mental global

NotebookLM est un moteur de distillation qui transforme un corpus en décisions et en artefacts.

On peut le résumer comme une chaîne :

- Collecter (sources crédibles + signaux d’usage).

- Isoler (travailler par catégorie de sources).

- Distiller (synthèses sauvegardées).

- Consolider (convertir en sources internes).

- Composer (features, MVP, documents).

- Exécuter (prototypage, dashboards, workflows).

Principes fondamentaux à forte valeur cognitive

- La compréhension vient du contraste des sources

Rapports donnent le “cadre”, UGC donne la “douleur”, méthodes startup donnent la “sélection”. - La sélection de sources est une décision produit

Elle détermine ce que vous verrez comme opportunité et comme priorité. - La distillation doit être sauvegardée, sinon elle n’existe pas

“Save to note” n’est pas une option : c’est la formalisation de la pensée. - Studio sert à changer de représentation pour stabiliser la compréhension

Audio pour digérer, mind map pour structurer, reports pour formaliser, quiz pour consolider. - Le MVP se construit par réduction, pas par accumulation

La compétence clé est de passer de “tout ce qu’on pourrait faire” à “les 2 choses qui comptent”. - NotebookLM clarifie ; les outils de build exécutent

Plus votre PRD/Prompt est clair, plus l’exécution devient rapide et fidèle.

Ce qui permet de raisonner correctement sur le sujet à long terme

Utiliser NotebookLM comme un système vivant :

- enrichir le corpus uniquement pour combler une lacune identifiée,

- convertir en source uniquement ce qui est fiable et réutilisable,

- produire à chaque itération un artefact qui réduit l’ambiguïté (brief, MVP, PRD),

- chaîner vers des outils externes uniquement quand l’intention est claire.

Ce cadre permet d’obtenir non pas “des sorties impressionnantes”, mais une capacité durable à comprendre vite, décider mieux, et construire plus efficacement à partir d’information complexe.

Auteur : WebToulouse

- SIRET : 534 913 769 00012

- Siège social : 1 impasse Jean-Pierre Blanchard, 31400 Toulouse, France

- Contact : 09 53 32 33 33 — contact@webtoulouse.fr

- Directeur de la publication : WebToulouse

- Dernière mise à jour :20/03/2026

- Corrections : En cas d’erreur ou d’information obsolète contactatwebtoulouse.fr